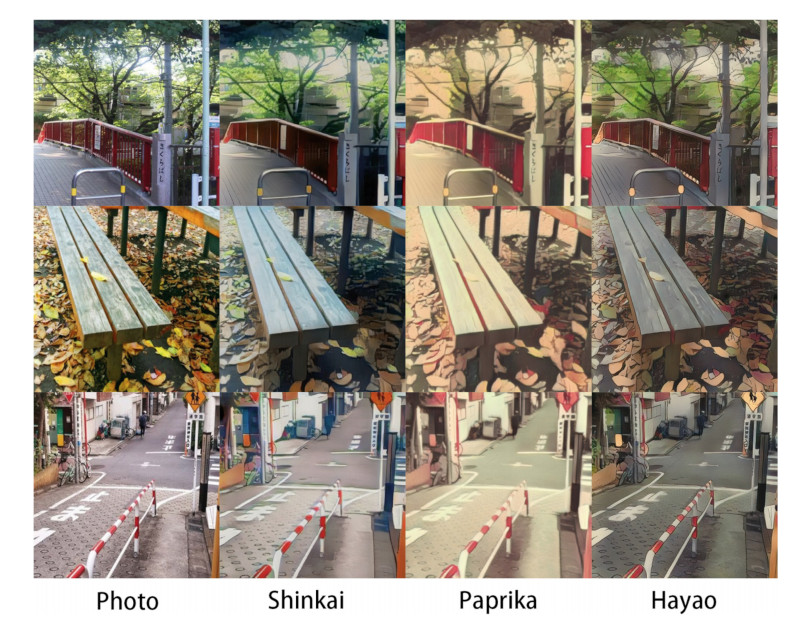

Uno studio di ricerca cinese portato avanti dalle università di Wuhan e dello Hubei hanno sviluppato un framework che, tramite l'utilizzo del machine learning, è in grado di trasformare fotografie di paesaggi reali in sfondi che sembrano usciti da un anime vero e proprio. Vedere per credere: qui sotto trovate alcuni risultati di questo esperimento, dove tre foto sono state ricreate rispettivamente negli stili di disegno tipici degli anime diretti da Hayao Miyazaki, Satoshi Kon e Makoto Shinkai.

Il framework in questione si chiama AnimeGAN: A Novel Lightweight GAN for Photo Animation e sfrutta reti neurali (neural style transfer e generative adversarial networks) per ottenere immagini in alta definizione e in breve tempo. Il suo obiettivo è quello di facilitare il lavoro degli artisti, permettendo loro di risparmiare tempo nel realizzare linee, texture, colori e ombre.

Gli autori Jie Chen, Gang Liu e Xin Chen hanno presentato questo progetto per la prima volta all'International Symposium on Intelligence Computation and Applications nel 2019 ed è stato pubblicato online lo scorso 26 maggio all'interno del sito per ricerche accademiche Springer Link. Su GitHub l'utente TachibanaYoshino ha implementato il codice sorgente di AnimeGAN utilizzando la piattaforma di machine learning Tensorflow. Chiunque è libero di scaricare da qui il codice e creare sfondi in stile anime a partire da immagini reali.

Fonte Consultata:

Anime News Network

Il framework in questione si chiama AnimeGAN: A Novel Lightweight GAN for Photo Animation e sfrutta reti neurali (neural style transfer e generative adversarial networks) per ottenere immagini in alta definizione e in breve tempo. Il suo obiettivo è quello di facilitare il lavoro degli artisti, permettendo loro di risparmiare tempo nel realizzare linee, texture, colori e ombre.

Gli autori Jie Chen, Gang Liu e Xin Chen hanno presentato questo progetto per la prima volta all'International Symposium on Intelligence Computation and Applications nel 2019 ed è stato pubblicato online lo scorso 26 maggio all'interno del sito per ricerche accademiche Springer Link. Su GitHub l'utente TachibanaYoshino ha implementato il codice sorgente di AnimeGAN utilizzando la piattaforma di machine learning Tensorflow. Chiunque è libero di scaricare da qui il codice e creare sfondi in stile anime a partire da immagini reali.

Fonte Consultata:

Anime News Network

I collegamenti ad Amazon fanno parte di un programma di affiliazione: se effettui un acquisto o un ordine attraverso questi collegamenti, il nostro sito potrebbe ricevere una commissione.

Chissà che anime han visto lol

A me sembrano filtri di instagram senza offesaXD

Meglio le foto al naturale, il giappone ha dei luoghi così semplici e belli, non serve vederli in modo diverso uvu

se prima guardo l'originale sembra effettivamente un filtro peggiorativo

Ho avuto la stessa impressione, e in questo caso, significa che ha cmq funzionato, perché, in pratica, vedendo un anime fatto in questo modo, non dovresti accorgertene perché non hai visto le foto originali.

Aggiungo solo che conta anche la grandezza delle immagini. Sto guardando dal mio cellulare e, rimpicciolite, non si nota una gran differenza tra le immagini, a parte i colori. Una volta ingrandite, si nota la differenza.

Cmq, per chi teme della "morte dell'arte" (per drammatizzare un po'), ricordatevi che i veri artisti sicuramente non si fermeranno semplicemente a passare questo "filtro" sulle foto originali. Quindi, secondo me, tutto bene, tutto scelta di stile.

Detto questo ricordo il software di colorazione automatica di OLM, non se n'è più saputo nulla. Poi c'è pure il tweening che non viene mai realmente usato se non in qualche prodotto europeo.

Sostituire la mano dell'artista non è semplice insomma.

Devi eseguire l'accesso per lasciare un commento.